สารบัญ:

- ผู้เขียน John Day day@howwhatproduce.com.

- Public 2024-01-30 13:03.

- แก้ไขล่าสุด 2025-06-01 06:10.

By sharathnaikSharathnaik.comติดตามเพิ่มเติมโดยผู้เขียน:

เกี่ยวกับ: วิศวกรรมและการออกแบบ More About sharathnaik »

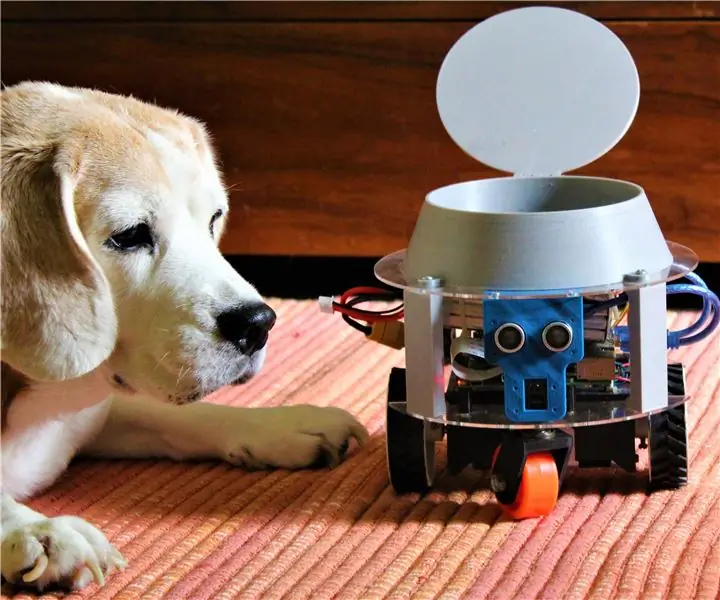

เมื่อเร็ว ๆ นี้ฉันพบว่าตัวเองกำลังดูซีรีส์ Netflix จำนวนมากเนื่องจากสถานการณ์ปัจจุบัน ฉันหวังว่าคุณทุกคนจะปลอดภัย และฉันเห็น Black Mirror ซีซั่นที่ 5 ออกฉายแล้ว ซีรีส์กวีนิพนธ์ที่เกี่ยวกับกลุ่มชีวิตส่วนตัวของผู้คนและเทคโนโลยีจัดการกับพฤติกรรมของพวกเขาอย่างไร

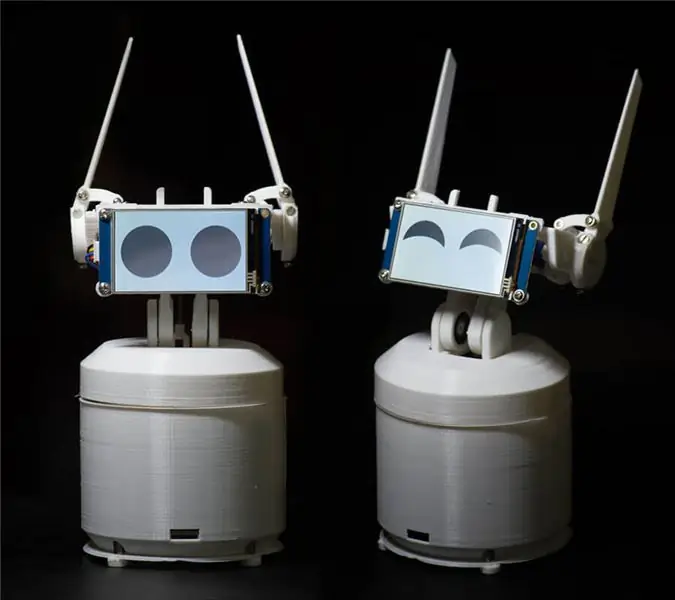

และตอนหนึ่งที่ดึงดูดความสนใจของฉันคือราเชล แจ็ค และแอชลีย์ด้วย หนึ่งในตัวละครหลักของซีรีส์นี้คือหุ่นยนต์ประจำบ้านชื่อ Ashley O และหุ่นยนต์ตัวนั้นก็มีคาแรคเตอร์มากมายรอบตัว และฉันคิดว่าสำหรับตัวเองฉันควรสร้างมันขึ้นมา มันเป็นโครงการที่ดีในการเริ่มต้นเขียนโปรแกรม ถ้าไม่ใช่อย่างน้อยก็อย่างน้อย ฉันสามารถตั้งโปรแกรมให้หัวเราะเยาะเรื่องตลกของฉันได้!

อะไร / ใครคืออีวอน? มันทำอะไรได้บ้าง?

ดังนั้น ก่อนที่ฉันจะเริ่มทำโปรเจ็กต์นี้ ฉันได้ตั้งกฎพื้นฐานที่ต้องปฏิบัติตาม โครงการนี้ต้องเป็น

- ง่ายสำหรับทุกคนที่จะลอง

- ไม่ใช่แค่น่ารักแต่ยังมีประโยชน์ด้วยเพื่อไม่ให้ไปอยู่ในหิ้ง

- แบบแยกส่วน เพื่อให้คุณสามารถเพิ่มคุณสมบัติใหม่ๆ ต่อไปได้

หลังจากตั้งกฎนี้แล้ว ฉันตัดสินใจใช้ Google Assistant SDK SDK นี้มีคุณสมบัติมากมายที่ฉันกำลังมองหา และถ้าคุณเบื่อ Ewon คุณจะใช้มันเป็นอุปกรณ์ Google Home เสมอ และทำในสิ่งที่ Google Home ทำ

สิ่งที่ Ewon จะทำคือการเพิ่มตัวละครให้กับผู้ช่วยของ Google นั่นคือการแสดงอารมณ์และตอบสนองต่อสิ่งที่ผู้ใช้พูด ตอนนี้ไม่ใช่แค่เสียงที่คุณได้ยิน แต่คุณยังจะได้เห็นปฏิกิริยาตอบสนองด้วย

หมายเหตุ: คำแนะนำนี้อยู่ระหว่างการพัฒนา ฉันจะอัปโหลดไฟล์ที่เกี่ยวข้องทั้งหมดในไม่ช้า ขอขอบคุณ

ขั้นตอนที่ 1: ชิ้นส่วนที่จำเป็นสำหรับ Ewon

อิเล็กทรอนิกส์

- ราสเบอร์รี่ PI

- เซอร์โว SG90 (x4)

- เซอร์โว MG995 - มาตรฐาน (x2)

- PCA9685 ไดร์เวอร์เซอร์โว 16 ช่อง

- การ์ดเสียง USB

- ไมโครโฟน

- ลำโพง (ลำโพงตัวเล็กอะไรก็ได้ประมาณนี้)

- ขั้วต่อขาตัวผู้และตัวเมีย

- เขียงหั่นขนม

- ถัดไปจอแสดงผล

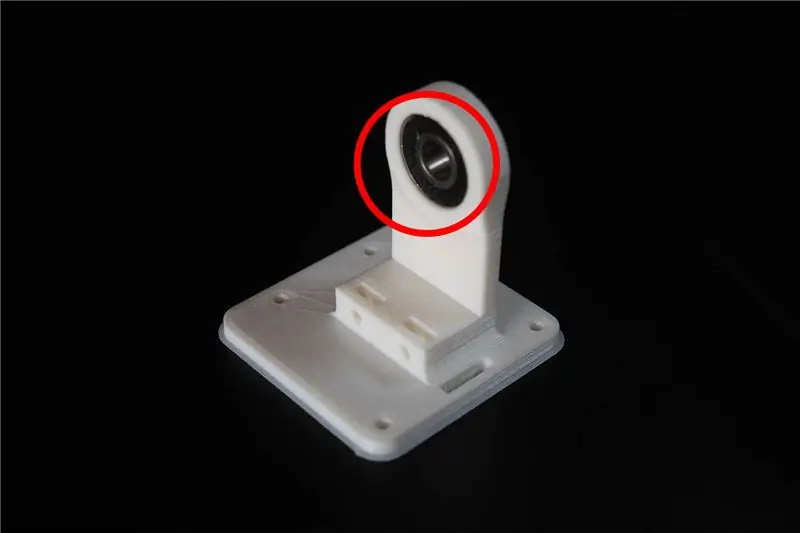

รัดและแบริ่ง

- M3*10 มม. (x10)

- M3*8mm (x10)

- ถั่ว M3 (x20)

-

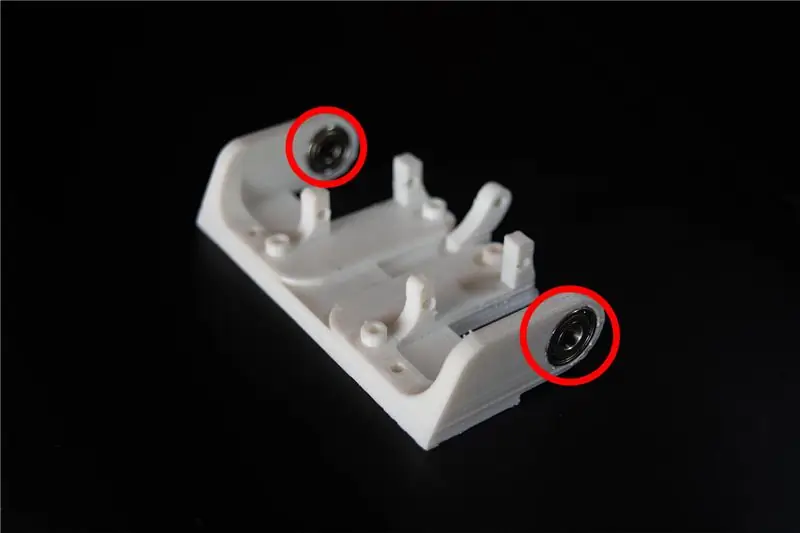

การแบก

- OD: 15 มม. ID: 6 มม. กว้าง: 5 มม. (x2)

- OD: 22 มม. ID: 8 มม. กว้าง: 7 มม. (x2)

วัสดุอื่นๆ

-

ขัดแย้ง

- 40 มม. (x4)

- 30 มม. (x4)

เครื่องมือ

เครื่องพิมพ์ 3 มิติ

ขั้นตอนที่ 2: ทำความเข้าใจ Ewon และการเขียนโปรแกรม

ก่อนที่ฉันจะเริ่มด้านการเขียนโปรแกรม ให้ฉันอธิบายสั้น ๆ เกี่ยวกับบล็อกไดอะแกรมของวงจรของ Ewon

RPI (Raspberry pi) เป็นสมองของระบบ ไดรเวอร์เซอร์โวควบคุมโดย RPI ขับเซอร์โว จอแสดงผลที่ควบคุมโดย RPI พร้อมการสื่อสารแบบอนุกรมเพื่อแสดงอารมณ์ และสุดท้ายคือไมโครโฟนและลำโพงที่ใช้สื่อสารกับอีวอน ตอนนี้เรารู้แล้วว่าฮาร์ดแวร์ตัวใดทำหน้าที่อะไร มาเริ่มเขียนโปรแกรม Ewon กัน

การติดตั้ง Google Assistant SDK

ให้ฉันอธิบายเหตุผลสองข้อว่าทำไมฉันจึงวางแผนที่จะใช้ Google Assistant:

- ฉันอยากให้อีวอนไม่ใช่แค่หุ่นยนต์ที่สนุกแต่ยังเป็นหุ่นยนต์ที่มีประโยชน์อีกด้วย Google Assistant SDK มีทรัพยากรมากมายที่คุณสามารถใช้เพื่อเพิ่มฟังก์ชันการทำงานของ Ewon ได้

- คุณยังสามารถใช้การกระทำบน google และโฟลว์การโต้ตอบเพื่อให้ Ewon สามารถสนทนาด้วยการตอบกลับที่กำหนดไว้ล่วงหน้าได้ สำหรับตอนนี้ เราจะเน้นเฉพาะ SDK พื้นฐานเท่านั้น

เริ่มต้นด้วยการติดตั้ง Google Assistant SDK ไม่น่าจะยากเพราะมีทรัพยากรมากมายที่จะช่วยคุณตั้งค่า Google Assistant SDK บน RPI คุณสามารถทำตามบทช่วยสอนนี้:

บทช่วยสอน:

หลังจากสิ้นสุดกระบวนการข้างต้น คุณควรจะสามารถคลิก Enter บนแป้นพิมพ์และพูดคุยกับผู้ช่วยได้ นั่นคือทั้งหมดที่เกี่ยวกับการติดตั้ง Google Assistant SDK

ฉันควรตั้งชื่อมันว่าอะไร? อีวอน?

เฮ้ Google! นั่นคือสิ่งที่ใช้เพื่อเริ่มพูดกับผู้ช่วยของ Google และขออภัยที่ Google ไม่อนุญาตให้ใช้คำปลุกที่กำหนดเองอื่น ๆ มาดูกันว่าเราจะเปลี่ยนสิ่งนี้ได้อย่างไร เพื่อให้ Google Assistant ทำงานเมื่อมีคนโทรหา Ewon

Snowboy: เอ็นจิ้นการตรวจจับคำที่ได้รับความนิยมสูงที่ปรับแต่งได้สูง ซึ่งฝังตัวในแบบเรียลไทม์ที่เข้ากันได้กับ Raspberry Pi, (Ubuntu) Linux และ Mac OS X

คำที่นิยม (หรือเรียกอีกอย่างว่าคำปลุกหรือคำเรียก) คือคำสำคัญหรือวลีที่คอมพิวเตอร์คอยฟังเป็นสัญญาณเพื่อกระตุ้นให้เกิดการกระทำอื่นๆ

เริ่มต้นด้วยการติดตั้ง Snowboy บน RPI อย่าลืมเปิดใช้งานสภาพแวดล้อมเสมือนเพื่อติดตั้ง Snowboy เช่นเดียวกับที่คุณทำในการติดตั้ง Assistant SDK ทุกสิ่งที่เราติดตั้งจากนี้ไปจะต้องได้รับการติดตั้งในสภาพแวดล้อมเสมือน การติดตั้ง Snowboy อาจยุ่งยากเล็กน้อย แต่ลิงก์นี้จะช่วยให้คุณติดตั้งได้โดยไม่มีปัญหาใดๆ ลิงค์:

ต่อไปนี้คือขั้นตอนการติดตั้งโดยสรุป หากลิงก์ด้านบนเกิดความสับสนหรือการติดตั้งล้มเหลว

$ [sudo] apt-get install libatlas-base-dev swig$ [sudo] pip ติดตั้ง pyaudio $ git clone https://github.com/Kitt-AI/snowboy $ cd snowboy/swig/Python3 $ ทำ $ cd.. /.. $ python3 setup.py build $ [sudo] python setup.py ติดตั้ง

เมื่อติดตั้งแล้ว ให้เรียกใช้ไฟล์สาธิต [พบในโฟลเดอร์ - snowboy/examples/Python3/] เพื่อดูว่าทุกอย่างทำงานได้อย่างสมบูรณ์หรือไม่

หมายเหตุ: คุณสามารถเปลี่ยนชื่อหุ่นยนต์ของคุณเป็นอย่างอื่นได้เช่นกัน สิ่งที่คุณต้องทำคือไปที่ https://snowboy.kitt.ai/ และฝึกคำสั่งให้ดำเนินการที่กำหนดเอง จากนั้นวางคำยอดนิยมนั้นลงในโฟลเดอร์เดียวกับ ewon.pmdl

อีวอนเข้าใจอารมณ์ได้ไหม?

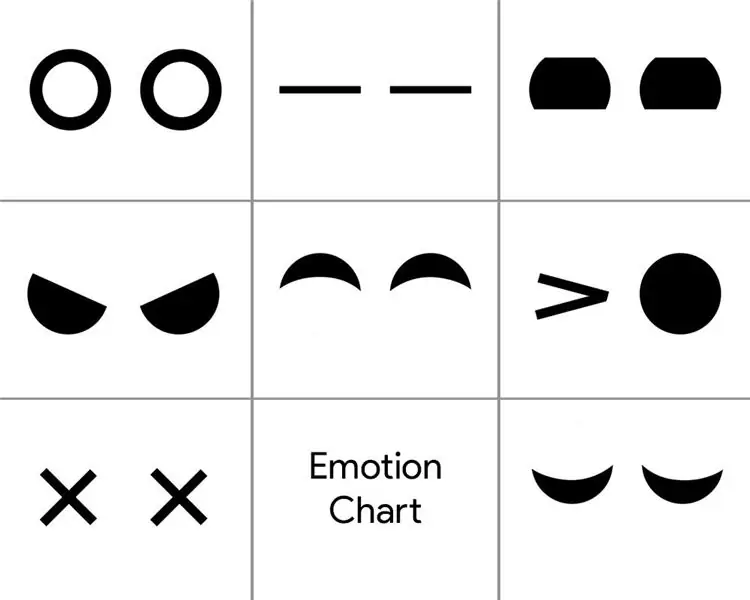

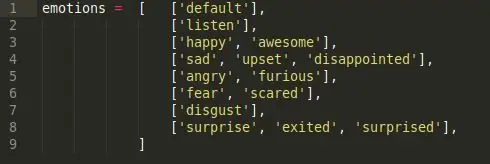

ตอนนี้อีวอนมีชื่อแล้ว ฉันจะใช้อีวอนแทนการเรียกมันว่าหุ่นยนต์ โอเค อารมณ์ ตอบสั้นๆ ไม่ใช่ อีวอนไม่เข้าใจอารมณ์ ดังนั้นสิ่งที่เราจะทำคือทำให้อีวอนตรวจจับอารมณ์ในคำพูดของเราโดยใช้คีย์เวิร์ด แล้วเล่นสีหน้าที่เกี่ยวข้องกับอารมณ์นั้น

เพื่อให้บรรลุสิ่งนี้ สิ่งที่ฉันทำคือสคริปต์วิเคราะห์ความรู้สึกง่ายๆ มี 6 คลาสอารมณ์ที่แตกต่างกัน

มีความสุข เศร้า โกรธ กลัว รังเกียจ และแปลกใจ เหล่านี้เป็นคลาสอารมณ์หลักและแต่ละรายการมีรายการคำหลักที่เกี่ยวข้องกับอารมณ์ (เช่น ดี, ดี, ตื่นเต้น, ล้วนเกิดขึ้นภายใต้อารมณ์แห่งความสุข).

ดังนั้นเมื่อใดก็ตามที่เราพูดคำหลักใดๆ ในกลุ่มอารมณ์ อารมณ์ที่เกี่ยวข้องก็จะถูกกระตุ้น ดังนั้นเมื่อคุณพูดว่า "เฮ้ อีวอน!" และรอให้อีวอนพูดและฉันก็พูดต่อว่า "วันนี้เป็นวันที่ดี!" มันหยิบคีย์เวิร์ด "ดี" และกระตุ้นอารมณ์ที่เกี่ยวข้องว่า 'ความสุข' ซึ่งกระตุ้นการแสดงออกทางสีหน้าของแฮปปี้

หูพวกนั้นติดอีวอนหรือเปล่า?

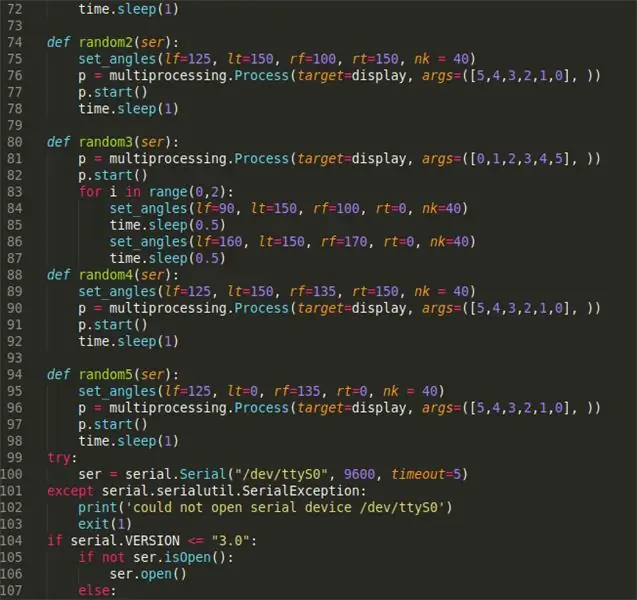

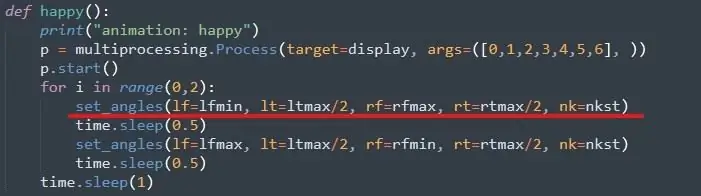

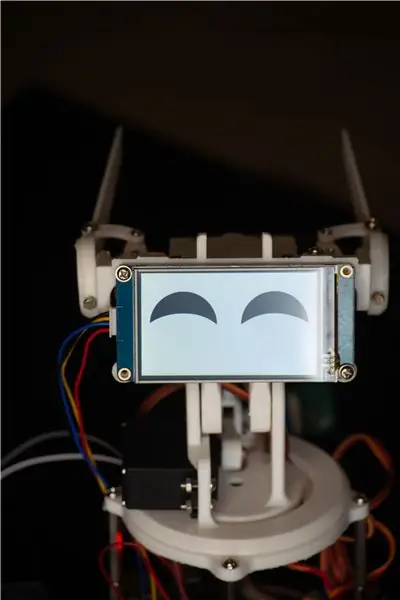

ขั้นตอนต่อไปคือการใช้อารมณ์ที่ถูกกระตุ้นเพื่อดำเนินการแสดงออกทางสีหน้าตามลำดับ สำหรับ Ewon การแสดงออกทางสีหน้าไม่ได้สังเกต แต่ขยับหูและคอโดยใช้เซอร์โวและเปลี่ยนการแสดงผลเพื่อเปลี่ยนการเคลื่อนไหวของดวงตา

ขั้นแรก เซอร์โว ในการรันสิ่งนี้ มันค่อนข้างง่าย คุณสามารถทำตามบทช่วยสอนนี้เพื่อตั้งค่าไลบรารีเซอร์โว Adafruit ลิ้ง:

จากนั้นเรากำหนดค่าสูงสุดและต่ำสุดสำหรับเซอร์โวทั้งหมด ทำได้โดยการย้ายเซอร์โวแต่ละตัวและตรวจสอบขีดจำกัด คุณสามารถทำสิ่งนี้ได้เมื่อคุณประกอบ Ewon แล้ว

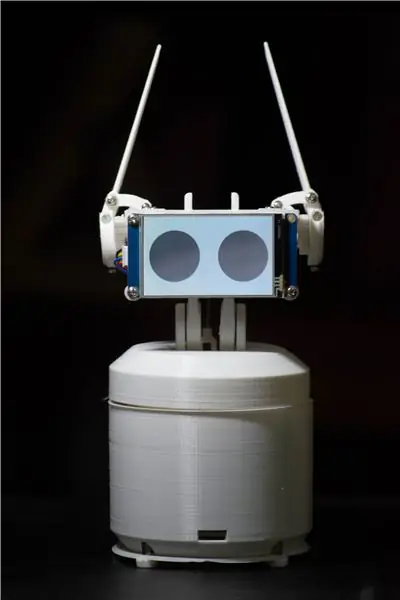

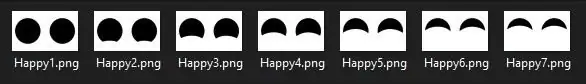

ตาเพื่ออีวอน

สำหรับดวงตา ฉันใช้จอแสดงผล Nextion ซึ่งมีรูปภาพมากมายดังนี้

เป็นลำดับภาพที่ฉันออกแบบใน Photoshop ซึ่งเมื่อเล่นตามลำดับจะสร้างแอนิเมชั่น ลำดับที่คล้ายกันถูกสร้างขึ้นสำหรับทุกอารมณ์ ตอนนี้เพื่อแสดงอารมณ์ใด ๆ สิ่งที่คุณต้องทำคือเรียกลำดับภาพเฉพาะซึ่งประกอบเป็นแอนิเมชั่น ไฟล์อยู่ในโฟลเดอร์ "แสดงไฟล์" ลิงก์ดาวน์โหลดด้านล่าง

ในที่สุด

เมื่อรวมทุกอย่างเข้าด้วยกันเมื่ออารมณ์แห่งความสุขถูกกระตุ้นโดยสคริปต์ ฟังก์ชันแห่งความสุขจะถูกเรียก และเซอร์โวจะเคลื่อนไปยังมุมที่กำหนดไว้แล้ว และจอแสดงผลจะเล่นแอนิเมชั่นดวงตาแห่งความสุข นี่คือวิธีที่เราบรรลุ "ความเข้าใจ" เกี่ยวกับอารมณ์ของมนุษย์ วิธีนี้ไม่ได้ดีที่สุดและมีบางครั้งที่คีย์เวิร์ดไม่อยู่ในอารมณ์เดียวกับที่กำหนดไว้ล่วงหน้า แต่สำหรับตอนนี้ วิธีนี้ใช้ได้ผลดีเพียงพอ และคุณสามารถเพิ่มคีย์เวิร์ดเพิ่มเติมได้เสมอเพื่อเพิ่มความแม่นยำในการตรวจจับ นอกจากนี้ยังสามารถแทนที่ด้วยโมเดลการวิเคราะห์อารมณ์ที่ได้รับการฝึกฝนมาเป็นอย่างดี เช่น โมเดลการวิเคราะห์อารมณ์ Paralleldots เพื่อให้ได้ผลลัพธ์ที่ดีขึ้น แต่เมื่อฉันลองมัน มีความล่าช้ามากซึ่งจะทำให้อีวอนตอบสนองช้าลง บางที Ewon เวอร์ชั่น 2.0 อาจจะมีประมาณนี้

นี่คือลิงค์ไปยังไฟล์ทั้งหมดที่จำเป็นในการรัน EWON ดาวน์โหลดไฟล์และทำตามขั้นตอนด้านล่าง:

- เปิดเครื่องรูดไฟล์วางโฟลเดอร์นี้ (Ewon) ที่บ้าน/pi/

- เพิ่ม Device Id และ Model ID ในไฟล์ main.py ได้รับ ID ขณะติดตั้ง Google Assistant SDK

- เปิดพรอมต์คำสั่งและเรียกใช้ซอร์สของคำสั่งต่อไปนี้:

แหล่งที่มา env/bin/activatepython main.py models/Ewon.pmdl

ขั้นตอนที่ 3: การพิมพ์ร่างกาย

คุณสามารถค้นหาไฟล์ 3 มิติได้ที่นี่:

ตอนนี้เราพร้อมแล้วกับสมองของ Ewon ถึงเวลาที่จะพิมพ์ร่างของมัน มีชิ้นส่วนที่ไม่ซ้ำกัน 18 ชิ้นที่จะพิมพ์ ส่วนใหญ่มีขนาดเล็กมาก โดยใช้เวลาพิมพ์รวมประมาณ 15-20 ชั่วโมง (ยกเว้นกรณี)

ฉันใช้ PLA สีขาวกับ infill 50% และความสูงของชั้น 2 มม. คุณสามารถเปลี่ยนค่าเหล่านี้ได้หากจำเป็น มันควรจะทำงานได้ดี แต่ต้องแน่ใจว่าชิ้นส่วนขนาดเล็กมีเนื้อเติม 100% เพื่อความแข็งแรง

หลังจากพิมพ์ไฟล์แล้ว คุณสามารถใช้กระดาษทรายหรือไฟล์ด้วยมือ และทำความสะอาดส่วนที่พิมพ์ออกมาโดยเฉพาะลิงก์ที่ส่วนต่างๆ เลื่อนผ่านกันและกัน การทำให้ข้อต่อเรียบขึ้นจะทำให้กลไกทำงานได้อย่างราบรื่นและให้ความต้านทานเซอร์โวน้อยลง กระบวนการนี้อาจใช้เวลานานเท่าที่คุณต้องการ เนื่องจากอาจหลงทางในการพยายามทำให้ชิ้นส่วนที่พิมพ์ออกมาดูสมบูรณ์แบบ

หมายเหตุเพิ่มเติม: คุณสามารถเจาะรูในชิ้นส่วนที่พิมพ์ 3 มิติได้อีกครั้งโดยใช้ดอกสว่านขนาด 3 มม. หลุมทั้งหมดมีขนาดเท่ากัน ซึ่งจะทำให้ง่ายขึ้นในขณะที่ขันน็อตในชุดประกอบในภายหลัง

ขั้นตอนที่ 4: นำอีวอนมารวมกัน

ก่อนที่เราจะเริ่มต้นด้วยการประกอบชิ้นส่วนที่พิมพ์ออกมาจำเป็นต้องดัดแปลงเล็กน้อย ไฟล์ที่ชื่อลิงค์เซอร์โวจะต้องติดตั้งลิงค์เซอร์โวที่มาพร้อมกับเซอร์โว ซึ่งจะทำให้ลิงค์ที่พิมพ์ 3 มิติสามารถเชื่อมต่อกับเซอร์โวได้ดี

การประกอบอีวอนควรตรงไปตรงมา ฉันได้แนบรูปภาพให้คุณตาม

หมายเหตุเพิ่มเติม: ตรวจสอบให้แน่ใจว่าคุณไม่ได้ขันสลักเกลียวหรือสกรูให้แน่นเกินไป เนื่องจากอาจทำให้ชิ้นส่วนที่พิมพ์เสียหายและสึกหรอได้

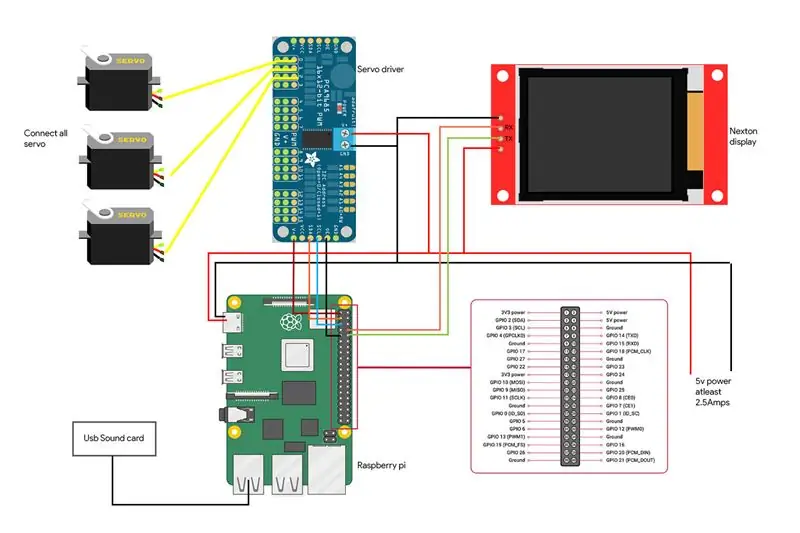

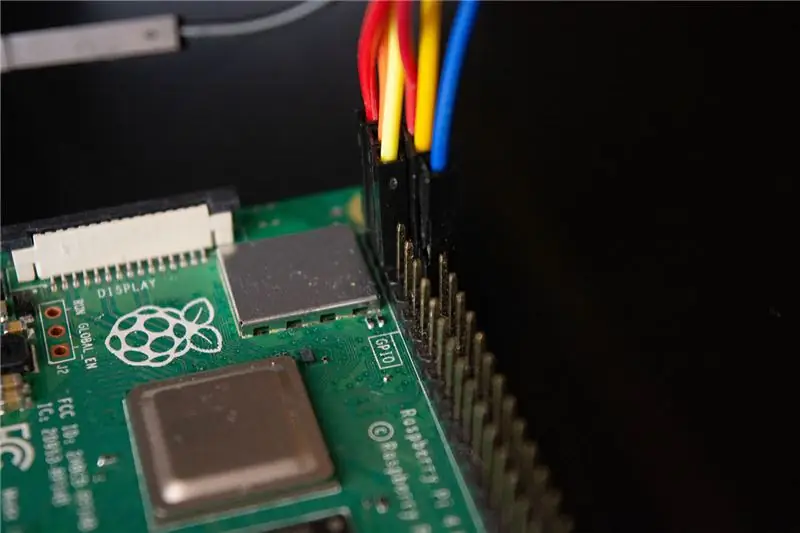

ขั้นตอนที่ 5: การเดินสาย Ewon

เราอยู่ในขั้นตอนสุดท้ายเพื่อทำให้อีวอนมีชีวิตขึ้นมา นี่คือแผนภาพการเดินสายไฟสำหรับส่วนประกอบต่างๆ พร้อมกับรูปภาพที่แสดงการเชื่อมต่อ

- ไดรเวอร์เซอร์โวเชื่อมต่อกับพิน I2C ที่เป็น SDA และ SCL ของ RPI

- จอแสดงผลเชื่อมต่อกับพิน RX และ TX ของ RPI

- ไมโครโฟนและลำโพงเชื่อมต่อกับการ์ดเสียง USB ซึ่งเชื่อมต่อกับ RPI ผ่านพอร์ต USB

คำเตือน: ระวังการลัดวงจร RPI ของคุณ โปรดตรวจสอบการเชื่อมต่อทั้งหมดของคุณสองครั้งและตรวจดูให้แน่ใจว่าคุณไม่ได้ทำผิดพลาด อุปกรณ์เสริมทั้งหมดที่เป็นลำโพง ไดรเวอร์เซอร์โว และจอแสดงผลใช้พลังงานจากแบตเตอรี่ 5v แยกต่างหาก และไม่ใช้สาย Raspberry Pi 5v Raspberry pi ใช้เพื่อส่งข้อมูลไปยังอุปกรณ์เสริมเท่านั้น แต่ไม่สามารถใช้เพื่อจ่ายไฟได้

ขั้นตอนที่ 6: เฮ้อีวอน! คุณได้ยินฉันไหม?

ดังนั้นเราจึงได้แนบอุปกรณ์เสริมทั้งหมดและติดตั้งไลบรารีที่จำเป็นทั้งหมด คุณสามารถเริ่ม Ewon ได้ด้วยการรันเชลล์สคริปต์โดยใช้./run Ewon.shแต่สคริปต์.sh นี้คืออะไร Ewon ใช้ไลบรารีต่างๆ มากมายด้วยสคริปต์ต่างๆ (Google Assistant SDK, Snowboy, Adafruit เป็นต้น) สคริปต์ทั้งหมดจะอยู่ในโฟลเดอร์ที่เกี่ยวข้อง (เราสามารถย้ายไฟล์ทั้งหมดในเส้นทางเดียวกันและจัดระเบียบสคริปต์ทั้งหมดได้ แต่ในปัจจุบัน ไลบรารีบางแห่งไม่อนุญาตให้ย้ายไฟล์ต้นทาง ดังนั้นสำหรับตอนนี้ เราจะเก็บไฟล์เหล่านั้นไว้ในตำแหน่งที่เกี่ยวข้องกัน).sh เป็นเชลล์สคริปต์ที่เรียกใช้สคริปต์เหล่านี้ทีละตัวจากทุกตำแหน่ง ดังนั้นคุณจึงไม่ต้องไปที่แต่ละตำแหน่งด้วยตนเองและเรียกใช้สคริปต์ ทำให้ง่ายต่อการจัดการคำสั่งทั้งหมด

เมื่อคุณเรียกใช้เชลล์สคริปต์แล้ว ให้พูดว่า "เฮ้ อีวอน!" และคุณควรเห็นอีวอนเริ่มฟังคุณ ตอนนี้คุณสามารถใช้ Ewon เป็นผู้ช่วยของ Google และพูดกับมัน และคุณสามารถเห็น Ewon เปลี่ยนสำนวนจากสิ่งที่คุณพูด ลองพูดว่า “เฮ้ อีวอน! วันนี้ฉันเศร้า” และคุณสามารถเห็นอีวอนกำลังเศร้ากับคุณ ถามอีวอนเรื่องตลกแล้วดูมันหัวเราะเยาะเรื่องตลก

ขั้นตอนที่ 7: อะไรต่อไป?

อีวอนไม่ได้หยุดอยู่แค่นี้ ตอนนี้อีวอนมีวิธีตรวจจับและแสดงอารมณ์ แต่เราสามารถทำได้มากกว่านั้น นี่เป็นเพียงจุดเริ่มต้น.

ในการอัปเดตที่จะมาถึง เราจะดำเนินการเกี่ยวกับวิธีทำ

- Ewon ตรวจจับใบหน้าและติดตามใบหน้าของคุณและเคลื่อนที่ไปพร้อมกับใบหน้าของคุณ

- เราจะเพิ่มเอฟเฟกต์เสียงเพื่อเพิ่มความลึกให้กับตัวละคร

- เพิ่มความคล่องตัวเพื่อให้ Ewon สามารถเคลื่อนที่ไปพร้อมกับคุณได้

หมายเหตุ: เนื่องจากสถานการณ์ปัจจุบัน เป็นเรื่องยากมากที่จะหาแหล่งชิ้นส่วนสำหรับโครงการ สิ่งนี้ทำให้ฉันเปลี่ยนการออกแบบและการทำงานโดยพิจารณาจากความคิดที่ฉันมีในสินค้าคงคลัง แต่ทันทีที่ฉันได้รับมือกับทุกส่วนแล้ว ระบบก็จะอัปเดตโปรเจ็กต์ด้านบนนี้

อัปเดต:

- ทำการเปลี่ยนแปลงบางอย่างในโค้ด ลบเชลล์สคริปต์

- เพิ่มตัวสี่เหลี่ยมสำหรับ EWON

แนะนำ:

Arduino Powered Painting Robot: 11 ขั้นตอน (พร้อมรูปภาพ)

Arduino Powered Painting Robot: คุณเคยสงสัยหรือไม่ว่าหุ่นยนต์สามารถสร้างภาพวาดและงานศิลปะที่น่าหลงใหลได้หรือไม่? ในโครงการนี้ ฉันพยายามทำให้สิ่งนั้นเป็นจริงด้วย Arduino Powered Painting Robot วัตถุประสงค์คือเพื่อให้หุ่นยนต์สามารถสร้างภาพวาดได้ด้วยตัวเองและใช้รีฟ

กันน้ำ Raspberry Pi Powered Wifi DSLR Webcam สำหรับ Time Lapses: 3 ขั้นตอน (พร้อมรูปภาพ)

กันน้ำ Raspberry Pi Powered Wifi DSLR Webcam สำหรับ Time Lapses: ฉันเป็นคนดูดเพื่อดูพระอาทิตย์ตกจากที่บ้าน มากเสียจนฉันได้รับ FOMO เล็กน้อยเมื่อพระอาทิตย์ตกดินและฉันไม่ได้อยู่บ้านเพื่อดู เว็บแคม IP ให้คุณภาพของภาพที่น่าผิดหวัง ฉันเริ่มมองหาวิธีนำกล้อง DSLR ตัวแรกกลับมาใช้ใหม่: Cano

Arduino และ Raspberry Pi Powered Pet Monitoring System: 19 ขั้นตอน (พร้อมรูปภาพ)

Arduino และ Raspberry Pi Powered Pet Monitoring System: เมื่อเร็ว ๆ นี้ในช่วงวันหยุด เราตระหนักว่าขาดการเชื่อมต่อกับสัตว์เลี้ยง Beagle ของเรา หลังจากการค้นคว้า เราพบผลิตภัณฑ์ที่มีกล้องถ่ายภาพนิ่งที่อนุญาตให้ตรวจสอบและสื่อสารกับสัตว์เลี้ยงของตนได้ ระบบเหล่านี้มีประโยชน์บางประการข

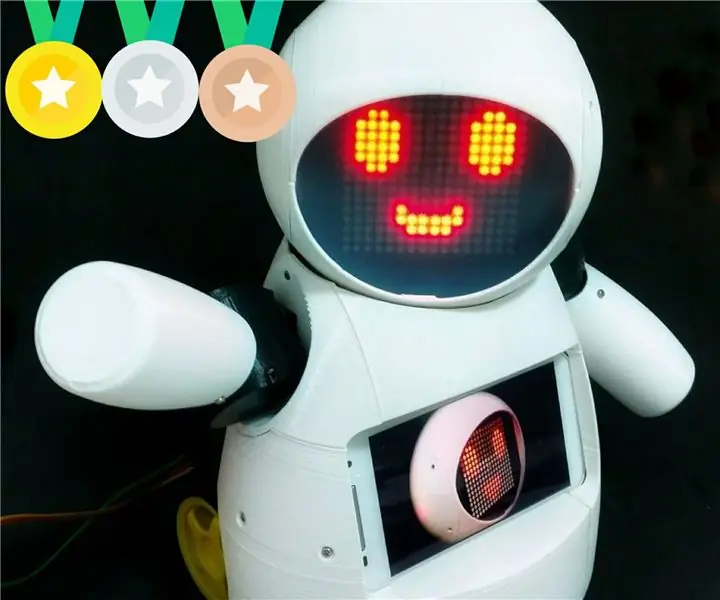

Joy Robot (โรโบ ดา อาเลเกรีย) - Open Source 3D Printed, Arduino Powered Robot!: 18 Steps (พร้อมรูปภาพ)

Joy Robot (Robô Da Alegria) - Open Source 3D Printed, Arduino Powered Robot!: รางวัลที่หนึ่งในการประกวด Instructables Wheels รางวัลที่สองในการประกวด Instructables Arduino และรองชนะเลิศใน Design for Kids Challenge ขอบคุณทุกคนที่โหวตให้เรา!!! หุ่นยนต์มีอยู่ทุกที่ ตั้งแต่งานอุตสาหกรรมไปจนถึงคุณ

Pi Home, ผู้ช่วยเสมือน Raspberry Powered: 11 ขั้นตอน (พร้อมรูปภาพ)

Pi Home, ผู้ช่วยเสมือนที่ขับเคลื่อนด้วย Raspberry: หน้าแรกของ Google มีประโยชน์ที่จะมีรอบ ๆ บ้าน เป็นอุปกรณ์ที่สวยงามพร้อม Google Assistant ในตัว - ผู้ช่วยส่วนตัวดิจิทัลที่ทันสมัยโดย Google มันสามารถเล่นสื่อ บันทึกการช่วยเตือนและบันทึกย่อของคุณ บอกระยะเวลาในการเดินทางของคุณ